如何看待 YouTube 上的 Elsagate 事件,儿童不宜内容被通过自动推荐算法,归类于儿童内容播放?

该问题总共获得了 4,651,255 次浏览

国内的几大视频网站已经开始着手清理相关视频(在有的答主那边看到快手上都有你敢信?),有几个关键字已经完全失效了。但仍不排除有漏网之鱼,请有条件的朋友多检查一下身边小孩用过的ipad,该举报的第一时间举报。有同学质疑说这个规模完全是个产业了可是怎么看不出如何盈利呢?事实上有些恶是没考虑利益的,就是纯粹的恶。

其实 YouTube 的 Elsagate 事件存在了很长一段时间了,这篇《一群变态锁定观看YouTube的孩童,我以前为他们工作》的英文原贴最早是去年 11 月发布在 Reddit 上,当时正值 YouTube 在媒体声讨下开始整顿网站内容,清理这些儿童不宜的视频。

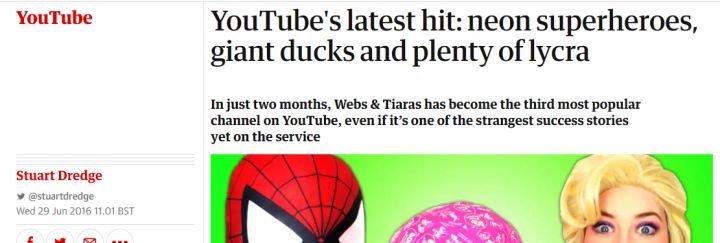

让我们把时间轴拖到 2016 年7月,英国《卫报》开始关注 YouTube 上这类面向儿童的暴力和色情内容。同年3月份,一个叫 Webs & Tiaras 的频道悄然出现在 YouTube 上,用蜘蛛侠、忍者神龟这些漫画中的超级英雄以及童话里的公主等人物制作成黄色暴力等儿童不宜的视频,这些视频有背景音乐但没有人物对话,而且还有多个语言版本,但它们都面向小孩播放。

仅仅两个月,这个频道的第一个视频就已经被观看 17 亿次,该频道也成为 YouTube 第三大流行频道(目前该频道已被 YouTube 关闭)。随后 YouTube 上一些 UP 主和 Reddit 论坛也开始质疑这种现象,但并未引起太大动静。

2017 年 3 月,BBC 发文批评称 YouTube 上数千个卡通视频中存在对儿童严重不适宜的内容,比如以《小猪佩奇》为题材制作的视频。猛一看这些视频和正常的《小猪佩奇》动画片没什么不同,但是一旦点开播放,视频内容就变得恐怖而黑暗,比如一个拿着大针管的牙医一下子拔掉了小猪佩奇的牙,然后佩奇刺耳的痛苦尖叫。其它深受儿童喜爱的动画片如《托马斯和朋友们》、《冰雪奇缘》等也被拿来制作了这样的视频。

国外很多父母平时都很喜欢在 YouTube 上给孩子找动画片看,经常也让孩子自己在 Kids Channel 上自己找感兴趣的动画片。因为在他们眼中,动画片是启迪孩子们思维的很好的方式,而 Kids Channel 已经帮孩子们过滤掉色情或是尺度大的影片,但家长们万万没想到,这类视频还是渗透了孩子们的世界。

可就是这样的动画片被自动推荐在 Kids Channel 列表上,在 YouTube 上已有几十万甚至上百万的浏览量。倘若每十个观看者中就有一个是儿童,那看过这些动画片的孩子肯定是数以百万计的。

随后舆论开始发酵,标签 #ElsaGate 成为 Twitter 和 Reddit 上的火热话题,很多父母愤怒的表达心中的忧虑。

人们将此次事件称为 ElsaGate(「艾莎门事件」),其中 Elsa 是动画片《冰雪奇缘》里的主角,YouTube 上出现的这些邪恶视频经常出现她的身影,而 Gate 一次自从「水门事件」后就经常被用来指代丑闻,ElsaGate 毫无疑问成了 YouTube 的丑闻。

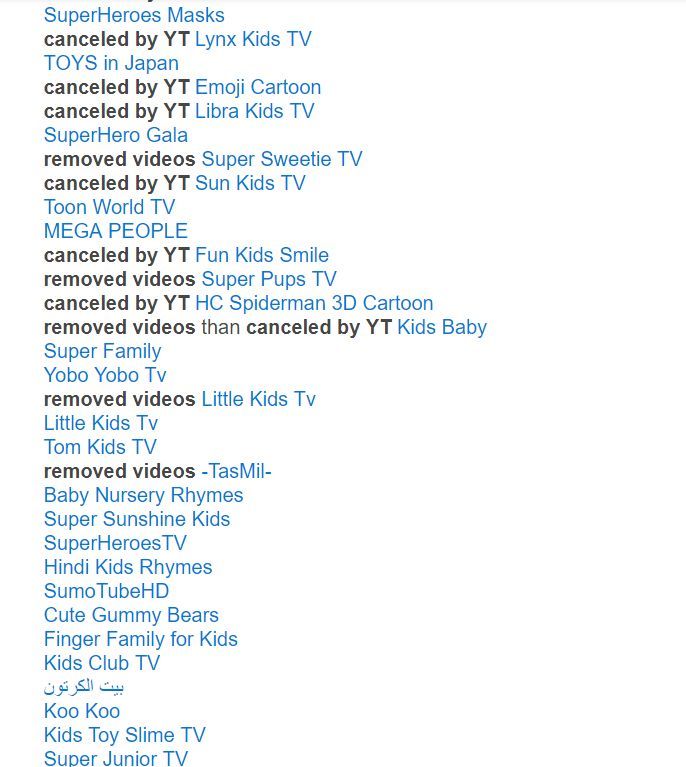

多家媒体纷纷开始关注此事,《纽约时报》、英国《周刊报道》等严词批评 YouTube 出现这种严重错误。记者 James Bridle 针对此事在 Medium 上发布了《Some Thing is Wrong in Internet》一文,质疑 YouTube 的视频推荐方式,引起人们的强烈共鸣。在舆论压力下,2017 年 11 月 YouTube 宣布采取措施,大规模整顿此类内容,关闭了大批频道,清除这些对儿童严重有害的视频。

《The London Economic》列出的部分被 YouTube 清理的视频及频道

至此事件回顾完毕

为何会出现这种问题?

第一个原因肯定是 YouTube 的视频审核系统不完善。目前全球平均每分钟就有长达 400 小时的视频被上传至 YouTube,以人工审核完这些视频是绝对不可能的,因此绝大部分都由程序自动审核。而由于当前视频识别技术并不完善,程序在审核视频时往往是通过关键词、文字描述、标签等方式进行自动筛选,如果视频发布人员提交视频时精心伪装,很容易就能蒙混过关。

2015 年初,YouTube 发布了专门面向儿童的 YouTube Kids,初衷是为家长们提供一个放心的平台,可以让孩子自己自行观看安全的视频内容。然而,由于通过了审核,这些以动画片为幌子的有害视频还是有很大一部分发送到了 YouTube Kids 上面。

第二个原因就是 YouTube 的算法推荐漏洞。记者 James Bridle 在文章中重点批评的也是 YouTube 的这种自动推荐算法。YouTube 的算法会根据用户观看的历史和视频关键词源源不断地给用户推荐相同类型的内容,这就导致一旦小孩观看一个这种有害视频,会有一大批同类视频推送给他,而且往往是自动播放。

去年网站 Tubefilter 曾发文详细谈及了 YouTube 的视频推荐算法。该算法给基于视频发布者的权值的权重很小,但给基于个人观看者的权值很大的权重。简单说就是,YouTube 不怎么关心你上传过什么视频,但很在意你看过什么视频。整个过程全是自动完成,没有人类参与,算法会实时分析数据,根据热度给视频排名,然后根据排名为用户推荐视频。

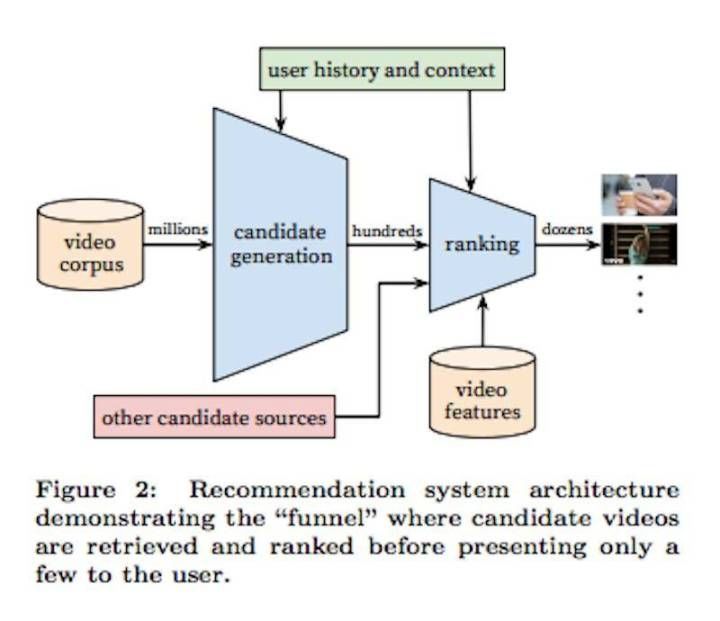

YouTube 的推荐算法架构大致分为两层,第一层叫「候选视频生成层」(Candidate Generation),第二层叫「排名层」(Ranking),如图:

如上图所示,首先算法从后台视频库中选取数百万个视频,传输至「候选视频层」,然后根据用户的观看历史和内容,从中抽取几百个视频传输至「排名层」,再根据视频特征、其它用户的观看状况和视频排名等数据,最终选出十几个视频推荐给用户。

通过这种方式,YouTube 可以给用户接连不断推送「符合用户口味」的视频。然而,这种算法虽然设计精巧,让人们在 YouTube 上观看到更多想看的视频,却忽略了一个很重要的因素:看这些视频的人是谁?

如果是正常的内容,这的确会让用户感到高兴,也省去了用户自己找同类型视频的麻烦,然而如果是 Elsagate 事件中的这种有害视频,而且观看它们的人还是儿童,算法仍然不停地向孩子推荐这种视频,可想而知这会给孩子的成长带来多大的危害。

其实单单从用户观看内容及浏览历史向用户推荐内容这种方式本身就有问题,所以另一家视频内容运营商 NetFlix 从2014年就逐渐停用这种根据观看历史推荐内容的做法,改用深度学习优化其推荐系统,更多的从观看用户是谁的角度考虑推荐内容。

或许 YouTube 除了花大力气研究推荐什么内容,也应该认真考虑算法把视频都推荐给了谁。